首页>>老刘专栏

Robots协议用来告知搜索引擎哪些页面能被抓取,哪些页面不能被抓取;可以屏蔽一些网站中比较大的文件,如:图片,音乐,视频等,节省服务器带宽;可以屏蔽站点的一些死链接。方便搜索引擎抓取网站内容;设置网站地图连接,方便引导蜘蛛爬取页面。下面是Robots文件写法及文件用法。

一、文件写法

User-agent: * 这里的*代表的所有的搜索引擎种类,*是一个通配符

Disallow: /admin/ 这里定义是禁止爬寻admin目录下面的目录

Disallow: /require/ 这里定义是禁止爬寻require目录下面的目录

Disallow: /ABC/ 这里定义是禁止爬寻ABC目录下面的目录

Disallow: /cgi-bin/*.htm 禁止访问/cgi-bin/目录下的所有以”.htm”为后缀的URL(包含子目录)。

Disallow: /*?* 禁止访问网站中所有包含问号 (?) 的网址

Disallow: /.jpg$ 禁止抓取网页所有的。jpg格式的图片

Disallow:/ab/adc.html 禁止爬取ab文件夹下面的adc.html文件。

Allow: /cgi-bin/ 这里定义是允许爬寻cgi-bin目录下面的目录

Allow: /tmp 这里定义是允许爬寻tmp的整个目录

Allow: .htm$ 仅允许访问以”.htm”为后缀的URL。

Allow: .gif$ 允许抓取网页和gif格式图片

Sitemap: 网站地图 告诉爬虫这个页面是网站地图

二、文件用法

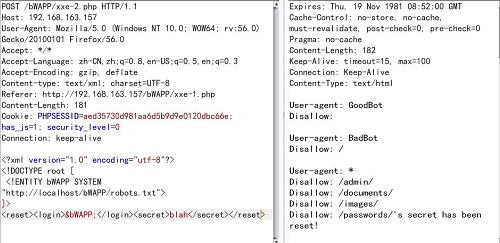

例1. 禁止所有搜索引擎访问网站的任何部分

User-agent: *

Disallow: /

实例分析:淘宝网的 Robots.txt文件

User-agent: Baiduspider

Disallow: /

User-agent: baiduspider

Disallow: /

很显然淘宝不允许百度的机器人访问其网站下其所有的目录。

例2. 允许所有的robot访问 (或者也可以建一个空文件 “/robots.txt” file)

User-agent: *

Allow: /

例3. 禁止某个搜索引擎的访问

User-agent: BadBot

Disallow: /

例4. 允许某个搜索引擎的访问

User-agent: Baiduspider

allow:/

例5.一个简单例子

在这个例子中,该网站有三个目录对搜索引擎的访问做了限制,即搜索引擎不会访问这三个目录。

需要注意的是对每一个目录必须分开声明,而不要写成 “Disallow: /cgi-bin/ /tmp/”。

User-agent:后的*具有特殊的含义,代表“any robot”,所以在该文件中不能有“Disallow: /tmp/*” or “Disallow:*.gif”这样的记录出现。

User-agent: *

Disallow: /cgi-bin/

Disallow: /tmp/

Disallow: /~joe/

Robot特殊参数:

允许 Googlebot:

如果您要拦截除Googlebot以外的所有漫游器不能访问您的网页,可以使用下列语法:

User-agent:

Disallow: /

User-agent: Googlebot

Disallow:

Googlebot 跟随指向它自己的行,而不是指向所有漫游器的行。

“Allow”扩展名:

Googlebot 可识别称为“Allow”的 robots.txt 标准扩展名。其他搜索引擎的漫游器可能无法识别此扩展名,因此请使用您感兴趣的其他搜索引擎进行查找。“Allow”行的作用原理完全与“Disallow”行一样。只需列出您要允许的目录或页面即可。

您也可以同时使用“Disallow”和“Allow”。例如,要拦截子目录中某个页面之外的其他所有页面,可以使用下列条目:

User-agent: Googlebot

Allow: /folder1/myfile.html

Disallow: /folder1/

这些条目将拦截 folder1 目录内除 myfile.html 之外的所有页面。

如果您要拦截 Googlebot 并允许 Google 的另一个漫游器(如 Googlebot-Mobile),可使用”Allow”规则允许该漫游器的访问。例如:

User-agent: Googlebot

Disallow: /

User-agent: Googlebot-Mobile

Allow:

使用 * 号匹配字符序列:

您可使用星号 (*) 来匹配字符序列。例如,要拦截对所有以 private 开头的子目录的访问,可使用下列条目: User-Agent: Googlebot

Disallow: /private*/

要拦截对所有包含问号 (?) 的网址的访问,可使用下列条目:

User-agent: *

Disallow: /*?*

使用 $ 匹配网址的结束字符

您可使用 $字符指定与网址的结束字符进行匹配。例如,要拦截以 .asp 结尾的网址,可使用下列条目: User-agent: Googlebot

Disallow: /*.asp$

您可将此模式匹配与 Allow 指令配合使用。例如,如果 ? 表示一个会话 ID,您可排除所有包含该 ID 的网址,确保 Googlebot 不会抓取重复的网页。但是,以 ? 结尾的网址可能是您要包含的网页版本。在此情况下,可对 robots.txt 文件进行如下设置:

User-agent: *

Allow: /*?$

Disallow: /*?

Disallow: / *?

一行将拦截包含 ? 的网址(具体而言,它将拦截所有以您的域名开头、后接任意字符串,然后是问号 (?),而后又是任意字符串的网址)。

Allow: /*?$ 一行将允许包含任何以 ? 结尾的网址(具体而言,它将允许包含所有以您的域名开头、后接任意字符串,然后是问号 (?),问号之后没有任何字符的网址)。

三、Robots协议举例

禁止所有机器人访问 User-agent: * Disallow: / 允许所有机器人访问 User-agent: * Disallow: 禁止特定机器人访问 User-agent: BadBot Disallow: / 允许特定机器人访问 User-agent: GoodBot Disallow: 禁止访问特定目录 User-agent: * Disallow: /images/ 仅允许访问特定目录 User-agent: * Allow: /images/ Disallow: / 禁止访问特定文件 User-agent: * Disallow: /*.html$ 仅允许访问特定文件 User-agent: * Allow: /*.html$ Disallow: /

尽管robots.txt已经存在很多年了,但是各大搜索引擎对它的解读都有细微差别。Google与百度都分别在自己的站长工具中提供了robots工具。如果您编写了robots.txt文件,建议您在这两个工具中都进行测试,因为这两者的解析实现确实有细微差别。

- 上一篇: 做优化遇到收录全部消失不见,是被k了吗?

- 下一篇: 不注意这些会毁掉你的网站

猜你喜欢

- 2024-09-25 大搜不否词转化效果更好?

- 2024-02-23 提高小红书运营效率的6个工具

- 2022-11-10 【官方文档】百度搜索网站被黑防范指南

- 2022-11-03 【干货必备】百度搜索优质内容指南

- 2022-08-01 百度隐藏“快照”功能:原因未知-百度快照没了?

- 2022-06-20 浅析“百度搜索基础信息设置规范”!

- 搜索

-

- 2024-10-23 15条素材秘诀,灭了你的同行!

- 2024-09-25 大搜不否词转化效果更好?

- 2024-09-21 5大自媒体平台区别

- 2024-09-20 135个投放必备网站,收藏就对了!!

- 2024-09-09 怀念19年前的投放环境吗?

- 2024-09-05 2万字,收下这份千川投放宝典!

- 2024-08-29 做小红书,远离这10大误区!

- 2024-08-27 AI不会取代优化师,但市场会!

- 2024-08-21 抖音现状:第一名吃肉,第二名喝汤,第三名···

- 2024-08-20 小红书算法,3招破解!

- 2024-08-15 小红书笔记「高危词」汇总

- 2024-08-10 PbootCMS使用MySQL数据库配置···

- 2019-11-01 Origin DNS error:使用百···

- 2020-06-20 “401 - 未授权: 由于凭据无效,访···

- 2020-12-01 一级域名好还是二级域名好?

- 2020-10-13 百度抓取诊断工具一直抓取失败怎么办?

- 2019-12-09 域名解析后,网站返回状态码511应对方法

- 2024-04-07 小红书+抖音+直播常见违禁词及替换方法

- 2020-04-10 百度下拉框怎么刷?刷百度下拉框软件原理及···

- 2021-04-13 html/txt文件中文用浏览器打开有乱···

- 2019-08-12 网站出现“403,服务器上文件或目录拒绝···

- 2021-01-06 百度移动端的搜索结果上线“踩顶”功能,对···

- 2020-10-20 UC神马搜索怎么做快速排名优化

- 2019-11-06 正确打开.db数据库文件的两种方式,避免···

- 2020-04-24 打击违规违法内容,百度又点名提醒了!

- 2020-03-12 新站做seo不同阶段,学会避开错误可成功···

- 2019-12-09 百度手机seo排名必须依靠PC站推动?不···

- 2021-01-04 SEO未来的重点是战略还是技术?

- 2020-08-11 seo遇到奇葩事情怎么处理?

- 2022-08-31 如何获取微信公众号图文封面

- 2020-01-09 除了写文章和换友链,seo还有能做哪些有···

- 2019-02-13 换友链的几个小技巧,快速提升权重!

- 2024-09-09 怀念19年前的投放环境吗?

- 2020-07-31 新网站为什么一直0收录,新网站收录窘境迅···

- 2019-03-18 为啥网站一直没收录?

- 2021-03-17 seo的自律:一天不写文章就难受?

- 热门标签

-

- 401错误

- 401未授权

- 语义效应

- 话术技巧

- 百度

- 谷歌

- pagerank算法

- 算法原理

- tab切换

- 选项卡滑动切换

- 达克效应

- 认知局限

- 交流分享

- 锚定效应

- webp转GIF

- webp格式转GIF动图

- webp to gif

- 万词霸屏

- SEO优化

- 按天计费系统

- 搜索推广模式对比

- 百度快排

- 快速排名

- SEO快排

- SEO优化师

- seo工资

- SEO快速排名

- 合肥seo

- seo公司

- 合肥优化公司

- 选择seo公司

- 互联网黑话

- 2019it黑话

- 百度熊掌号

- 网站被k

- 收录消失

- seo计费系统

- 网页劫持

- seo外包

- 外包公司

- seo职业发展

- 灰色样式

- FTP

- ftp隐藏文件

- seo改版

- 网站改版周期

- 百度公告

- spider爬虫

- 伪静态

- 纯静态

- seo友好度

- 在家办公

- 301重定向

- 首选域名

- 301跳转

- seo误区

- 企业主

- seo内容

- 优质内容

- seo策略

- seo平衡

- seo和可访问性

- 中文搜索

- 头条搜索

- 中文搜索引擎起源和发展

- 黑帽SEO

- 刷快排

- 二类电商

- 屏蔽右键

- 禁止右键

- 禁止查看源代码

- 网站改版

- seo部署

- 重复内容

- 重复页面

- 头条权重

- 私域流量

- 友情链接

- 被惩罚链接

- 百度小程序

- 小程序

- seo前景

- seo发展

- 2019冬至

- 冬至

- 内啡肽

- seo习惯

- 跳出率

- 用户体验

- 转化率

- 百度算法

- 算法更新

- 网站排名波动

- 网站惩罚

- seo顾问

- seoer

- 提升seo价值

- seo监测

- seo高手